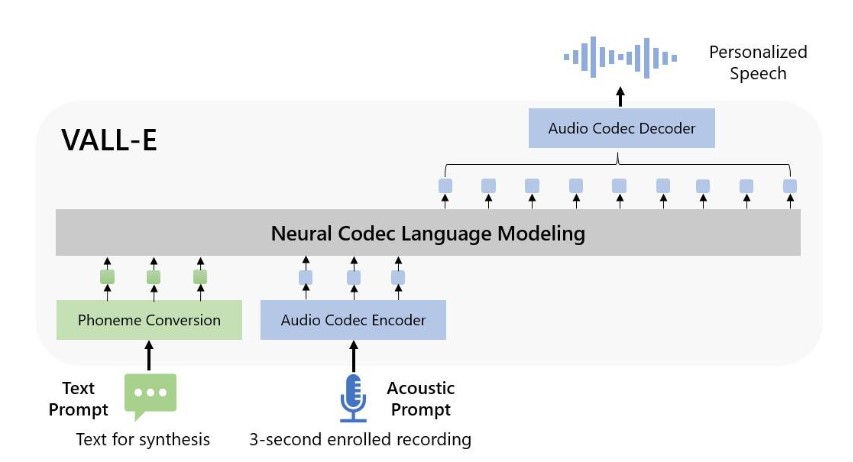

Vall-E è in grado di produrre un “discorso personalizzato di alta qualità” con nient’altro che una registrazione di tre secondi di qualsiasi persona

Nel 2022 siamo stati presi d’assalto dai nuovi strumenti di intelligenza artificiale. Solo per fare alcuni esempi: ChatGPT, Dall-E, Lensa… e il 2023 non sembra essere da meno. In pochi mesi abbiamo scoperto la capacità di queste AI in termini di creatività ed efficienza. Siamo stati sommersi da saggi, opere d’arte e video stranamente convincenti, creati con nient’altro che un input testuale. Ora tocca al sonoro e sul palco, sotto i riflettori, ora c’è Vall-E di Microsoft.

Scopriamo insieme di cosa si tratta.

Leggi anche: Replika, un’intelligenza artificiale per amica

Vall-E è un nuovo sistema AI Text To Speech (TTS) che può prendere una registrazione di tre secondi della voce di qualcuno e replicarla, trasformando in un secondo momento il testo in parlato. L’idea non è veramente nuova, ma c’è un elemento spiazzante: la spaventosa bravura di questa intelligenza artificiale nel convincerci che l’output sonoro provenga da un vero essere umano, quando in realtà non è così.

Ascolta il nostro podcast: La fiducia nelle nuove tecnologie

Ma in che modo Vall-E riesce a fare questa magia?

I portavoce di Microsoft hanno affermato che questo strumento utilizza

“un approccio diverso rispetto ad altri generatori di voci che lo hanno preceduto, che lo aiuta a raggiungere una precisione molto più elevata. I dati di addestramento TTS sono stati ridimensionati fino a 60mila ore di parlato in inglese, un numero centinaia di volte più grande dei sistemi esistenti. Ciò consente al sistema TTS di produrre un discorso personalizzato di alta qualità con nient’altro che una registrazione di tre secondi di qualsiasi persona come suggerimento acustico.”

Ascolta il nostro podcast: Ucraina – Putin, un’intelligenza artificiale sarebbe mai entrata in guerra?

Gioie e dolori.

Riusciamo a immaginare quanti possibili casi d’uso può avere questo tipo di “colpo teatrale”? Infiniti, alcuni pericolosi (come sempre).

Una storia già raccontata. Infatti, abbiamo già visto deepfake diffondere disinformazione e ispirare complottismi vari, quindi sarà interessante vedere come andranno le cose con Vall-E se e quando sarà reso pubblico.

Una speranza, però, c’è. Pensiamo che potrebbe essere uno strumento per dare la possibilità alle persone che hanno perso l’uso della voce di “farsi sentire” ancora. Pensiamo alla possibilità di parlare con i nostri defunti amici e parenti. Davvero è solo utopia?

Leggi anche: Non c’è ritorno dalla morte… se non sotto forma di avatar